“En mi cuarto año de universidad hice un intercambio en Nueva York. En esa época [2019], una comunidad de afroamericanos había ganado una causa en contra de distintos sistemas de seguridad con reconocimiento facial en Brooklyn. Me pareció increíble que se tomen nuestros datos biométricos sin permiso”, cuenta la fundadora de la start-up italiana de moda Capable, Rachele Didero. El incidente la dejó pensando. Estos sistemas, populares en países como Estados Unidos, Reino Unido y China, registran las características faciales de las personas sin su consentimiento, algo que, en su opinión, es muy poco ético. Pero ¿existiría alguna forma de esquivarlos?

A los pocos meses, Didero presentó la idea a un profesor suyo de la universidad: un mecanismo de evasión de la vigilancia biométrica mediante el uso de tejidos. Creía que su propuesta sería desestimada por completo, pero se convirtió en su tema de investigación para el doctorado en el Politécnico de Milán. La diseñadora recuerda: “Ni siquiera sabíamos si iba a ser posible, pero me alentó a investigarlo. Tuvimos que ir experimentando poco a poco”. Así comenzó un largo viaje de ensayo y error, que la llevó a la Universidad de Berkeley (EEUU), a Israel y después, de nuevo, a Milán. “En 2020 desarrollamos una colección de ocho prendas con esta tecnología. Esto lo hicimos en Tel Aviv, ya que allí tenían herramientas muy avanzadas. Después, volví a Milán para patentarlo”, señala. En los próximos meses el proyecto será presentado también en el Instituto Tecnológico de Massachusetts (MIT).

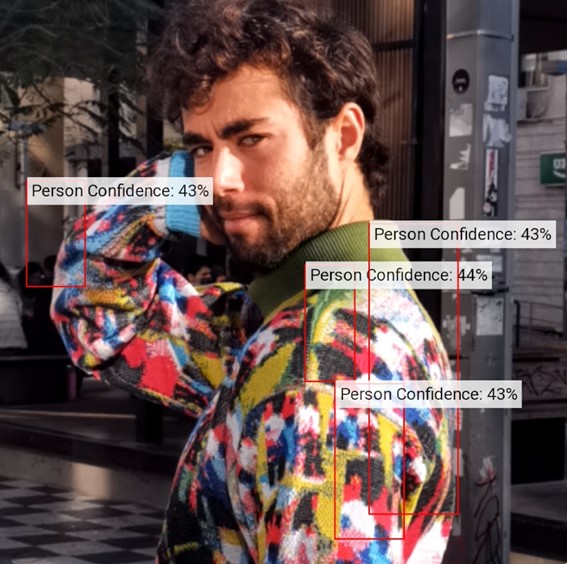

Las prendas de Capable tienen diseños con patrones que desorientan la atención del algoritmo de la inteligencia artificial (IA). Estos reciben el nombre de tejido adversario, y confunden a los sistemas de seguridad. De momento, se producen únicamente en Italia y solo se pueden elaborar en un tipo de tela llamado Jacquard. Las propiedades y la textura de este material lo hacen ideal para poder captar la atención de los sistemas de seguridad que funcionan con reconocimiento facial. No obstante, la efectividad de las prendas varía en función del porcentaje del cuerpo que esté cubierto.

Didero detalla: “Funciona como un código QR, pero al revés. Cuando escaneamos algo con el móvil, el código nos dota de cierta información particular. Nuestros tejidos, en cambio, dan demasiada información a la inteligencia artificial y así pueden captar la atención del algoritmo. No son como la capa invisible de Harry Potter, pero nos permite distraerla del rostro del individuo”. En este contexto, el proceso de Capable busca que los patrones de dos dimensiones parezcan volúmenes de tres dimensiones. Así, muchas veces los sistemas de vigilancia terminan identificando al portador de la prenda como si fuera algún otro ser vivo, por ejemplo, una cebra, una jirafa o un perro.

Un informe de 2019 de Carnegie Endowment for World Peace revelaba que al menos 64 países ya utilizan sistemas de vigilancia biométrica para monitorizar a sus ciudadanos. China es el principal difusor de esta tecnología a nivel global, con empresas como Huawei, Hikvision, Dahua y ZTE, suministrando estas herramientas a 63 países. Tan solo Huawei es responsable de proporcionar estos productos a al menos 50 países en todo el mundo. Del otro lado, empresas estadounidenses como IBM, Palantir y Cisco proveen a 32 países. “El problema es que no hay una ley que nos proteja. En una web podemos decir no a las cookies, pero a las cámaras de la calle no podemos decirles no. Están utilizando nuestros datos sin nuestra autorización y es un problema que ocurre en todo el mundo”, avisa Didero.

El informe también afirma que, irónicamente, son las democracias las principales usuarias de la vigilancia de IA, entre ellas Francia, España y Alemania. De hecho, el índice muestra que el 51% de las llamadas democracias avanzadas implementan estos sistemas. Por el contrario, el 37% de los estados calificados como autocráticos cerrados, el 41% de los estados autocráticos electorales/autocráticos competitivos y el 41 % de las democracias electorales/democracias iliberales, implementan este tipo de herramientas.

Didero asegura que nunca ha tenido ningún problema con las autoridades. Incluso colabora con algunas instituciones que buscan proteger la privacidad. En esta línea, ella y su equipo también investigaron la legalidad de su proyecto. Tras consultar con múltiples especialistas, están seguros de que cumple todas las normativas europeas. Es más, han renunciado a producir ninguna prenda que cubra la cara completamente, para evitar que sean bloqueadas en ciertos países. “Además, toda la colección es muy colorida y llamativa. No serviría para asaltar un banco porque inmediatamente llamarías la atención”, ironiza.

IA PARA LOS SERVICIOS DE SEGURIDAD

Empresas. Muchas compañías del mundo ya utilizan tecnología biométrica para controlar al personal que accede a sus instalaciones. Muchas veces suelen emplear las proporciones y características del rostro para identificarse, por encima de la huella digital.

Aeropuertos. Los aeropuertos de Estados Unidos y la Unión Europea ya usan parcialmente tecnología biométrica para algunos procesos. Sus sistemas también los emplean para identificar posibles amenazas o riesgos en las terminales.

Futuro. Algunos especialistas sugieren que en los próximos años la inteligencia artificial misma podrá ser empleada para burlar algunos de estos sistemas de seguridad, puesto que tecnologías como los deepfakes podrían ser aprovechadas para engañar a los sistemas de vídeo. Asimismo, ya existen algunos sistemas capaces de burlar las huellas digitales y otros sistemas.